Inversores

Resumen de inversión para FRC: qué es, qué se mide y qué se construirá a continuación.

This page is translated for accessibility. Primary version: /en/investors

La tokenización y la atención discreta son excelentes abstracciones para el texto, pero descartan la fase y la estructura continua. FRC propone representaciones y arquitecturas nativas de resonancia para dominios de fase coherente.

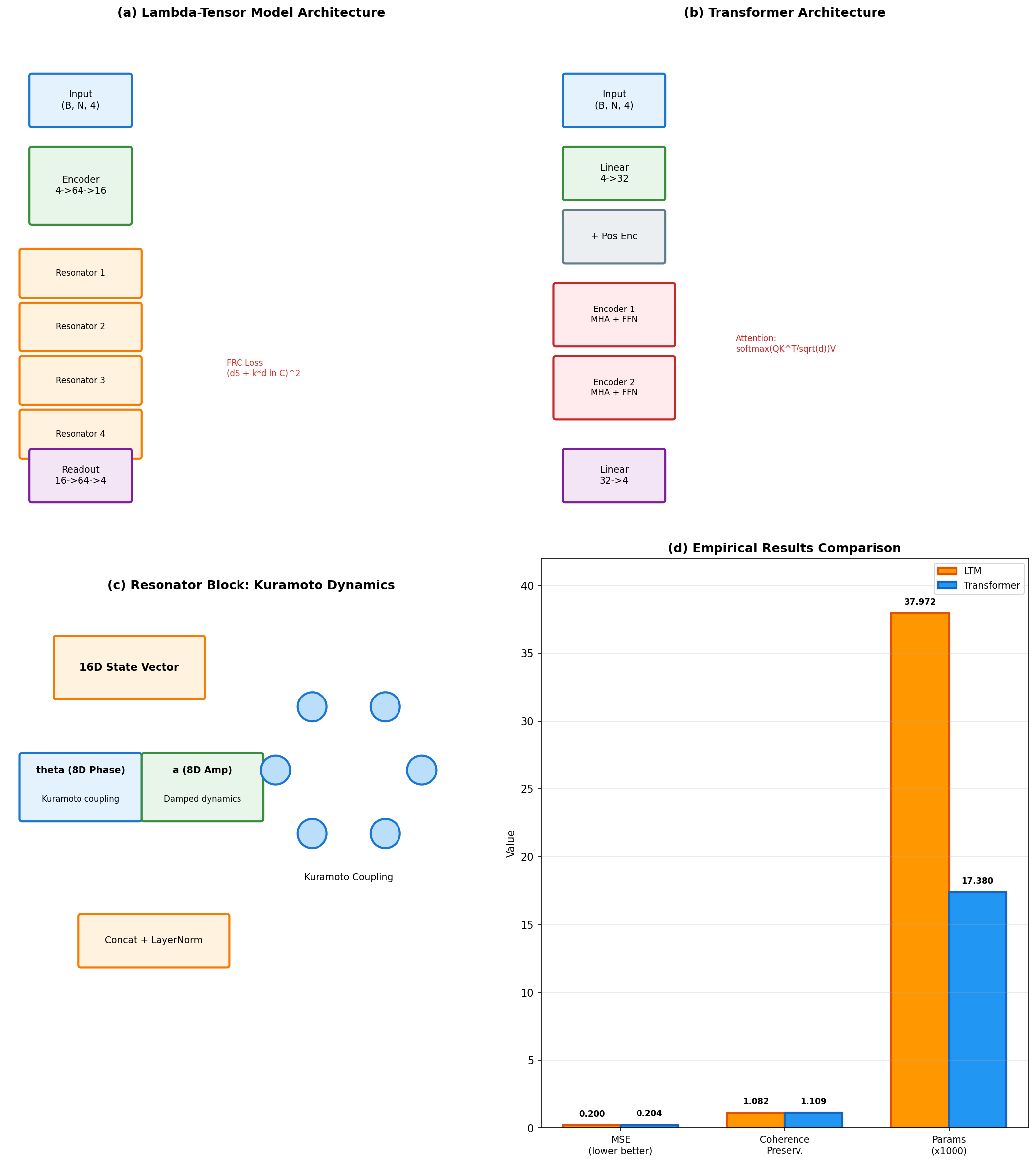

El canon se publica como artículos numerados con IDs estables e hipótesis explícitas. El seguimiento actual de la IA es el Modelo de Tensor-Λ (LTM) y su evaluación comparativa empírica frente a la atención en tareas de coherencia de fase.

Con flujos de trabajo agénticos + recuperación, podemos mantener un corpus riguroso, realizar experimentos repetibles e iterar sobre la arquitectura sin corromper la capa de referencia.

FRC-840-001

The Engine (LTM): attention → resonance.

FRC-16D-001

Protocol: Universal Vector for cognitive state.

FRC-840-LTM-001

Empirical: LTM vs Transformer on phase coherence.

What we’re building next

- - Más evaluaciones empíricas en dominios oscilatorios (audio, bioseñales, control).

- - Un SDK limpio + sistema de despacho de tareas para flujos de investigación repetibles (SOS).

- - Una capa de suscripción de «memoria espejo» para flujos de trabajo de IA personales (Mumega).

What to evaluate

- - ¿Puede LTM reproducir la evaluación comparativa con un script de entrenamiento mínimo y semillas fijas?

- - ¿Se generaliza el enfoque más allá de la tarea publicada a dominios de fase coherente adyacentes?

- - ¿Está el canon lo suficientemente estructurado para que los agentes lo citen (IDs), lo recuperen (grafo) y no alucinen?